TensorFlowで学習率を動的に変更!モデル性能への影響を可視化する方法

TensorFlowを使用して学習率を動的に変更する方法と、その変更がモデルの性能にどのような影響を与えるかを探ります。学習率は、モデルがデータから学習する速度を制御する重要なパラメータであり、適切に設定することでモデルの精度や収束速度を最適化できます。本記事では、TensorBoardを活用して学習率の変化とモデルの性能指標(精度や損失)の関係を可視化する方法を解説します。また、AdamやAdagradといった適応的学習率アルゴリズムの活用についても触れ、学習率の自動調整がどのようにモデルの性能向上に寄与するかを考察します。

イントロダクション

TensorFlowを使用して機械学習モデルを構築する際、学習率はモデルの性能に大きな影響を与える重要なパラメータです。学習率は、モデルが新しい情報をどれだけ速く学習するかを決定し、適切に設定されていない場合、モデルの収束速度や最終的な精度に悪影響を及ぼす可能性があります。特に、動的な学習率の調整は、モデルの学習プロセスを最適化するための有効な手法です。

学習率が高すぎると、モデルは急速に学習を進めますが、過学習のリスクが高まります。一方、学習率が低すぎると、モデルは安定して学習を進めることができますが、収束に時間がかかり、計算コストが増大する可能性があります。このバランスを取るために、TensorFlowでは学習率スケジューリングや適応的学習率アルゴリズムを活用することが推奨されます。

さらに、TensorBoardを使用することで、学習率の変化とモデルの精度や損失の関係を視覚的に確認することができます。これにより、学習率の調整がモデルの性能にどのように影響を与えるかを直感的に理解することが可能です。例えば、AdamやAdagradなどの適応的学習率アルゴリズムは、学習率を自動的に最適化するため、手動での調整を最小限に抑えることができます。これらの手法を活用することで、より効率的なモデル学習を実現することができるでしょう。

学習率の重要性

学習率は、機械学習モデルのトレーニングにおいて最も重要なハイパーパラメータの一つです。これは、モデルが各ステップでパラメータを更新する際のステップサイズを決定します。学習率が高すぎる場合、モデルは急速に学習しますが、最適解を飛び越えてしまい、収束が不安定になる可能性があります。逆に、学習率が低すぎる場合、モデルはゆっくりと学習し、最適解に到達するまでに多くの時間を要します。このため、適切な学習率の選択は、モデルの性能と効率に直接的な影響を与えます。

さらに、学習率はモデルの汎化性能にも影響を与えます。適切な学習率を設定することで、モデルはトレーニングデータに過剰に適合することなく、未知のデータに対しても良好な性能を発揮することができます。このバランスを取ることが、機械学習モデルの成功の鍵となります。

TensorFlowでは、学習率を動的に調整するためのさまざまな方法が提供されています。これにより、トレーニングプロセス中に学習率を最適化し、モデルの性能を向上させることが可能です。次のセクションでは、これらの方法について詳しく説明し、その効果を可視化する方法を紹介します。

TensorFlowでの学習率の動的変更方法

TensorFlowでは、学習率を動的に変更することで、モデルの学習プロセスをより柔軟に制御することが可能です。学習率スケジューリングは、学習の進行に応じて学習率を調整する手法で、これによりモデルの収束速度や最終的な性能を向上させることが期待されます。例えば、初期段階では高い学習率を設定して迅速に学習を進め、後半では学習率を徐々に下げて微調整を行うことが一般的です。

TensorFlowでは、tf.keras.optimizers.schedulesモジュールを使用して、学習率を動的に変更するスケジューラを簡単に実装できます。ExponentialDecayやPiecewiseConstantDecayなどのスケジューラを使用することで、学習率を指数関数的に減少させたり、特定のエポックで学習率を段階的に変更したりすることが可能です。これにより、モデルの学習プロセスをより細かく制御し、過学習や未学習のリスクを軽減することができます。

さらに、TensorBoardを使用することで、学習率の変化とモデルの性能指標(精度や損失)の関係をリアルタイムで可視化することができます。これにより、学習率の調整がモデルに与える影響を直感的に理解し、最適な学習率スケジュールを見つけることが容易になります。学習率の動的変更は、モデルの性能向上に大きく寄与する重要なテクニックです。

学習率の変化がモデルに及ぼす影響

学習率は、機械学習モデルの訓練プロセスにおいて非常に重要な役割を果たします。このパラメータは、モデルがデータから学習する速度を決定し、過学習や未学習といった問題を引き起こす可能性があります。高い学習率を設定すると、モデルは素早く学習を進めることができますが、最適解を見逃してしまうリスクがあります。一方、低い学習率では、モデルはゆっくりと学習を進めるため、精度は向上しますが、訓練に多くの時間を要します。

学習率を動的に変更することで、これらの問題を緩和することが可能です。例えば、訓練の初期段階では高い学習率を設定し、モデルが素早く学習を進めるようにします。その後、訓練が進むにつれて学習率を徐々に低下させることで、モデルが最適解に近づくように調整します。このようなアプローチは、学習率スケジューリングと呼ばれ、モデルの性能を向上させるための一般的な手法です。

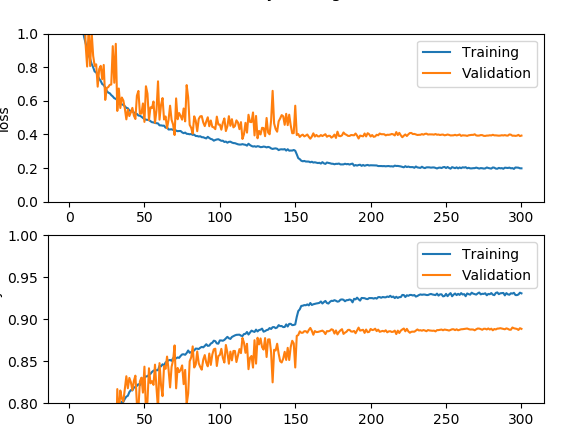

TensorFlowでは、TensorBoardを使用して学習率の変化とモデルの性能を可視化することができます。これにより、学習率の調整がモデルの精度や損失にどのように影響を与えるかを視覚的に確認することが可能です。また、AdamやAdagradなどの適応的学習率アルゴリズムを使用することで、学習率を自動的に最適化することもできます。これらのアルゴリズムは、訓練中に学習率を動的に調整し、モデルの性能を最大化するための効果的な方法です。

TensorBoardを使った可視化

TensorBoardは、TensorFlowの強力な可視化ツールであり、モデルの学習プロセスをリアルタイムで監視するための重要な役割を果たします。特に、学習率の変化がモデルの性能にどのように影響を与えるかを視覚的に確認するために、TensorBoardは非常に有用です。学習率が高すぎると、モデルは急速に学習を進める一方で、過学習のリスクが高まります。逆に、学習率が低すぎると、モデルの収束に時間がかかり、最適な性能に到達するまでに多くのイテレーションが必要となります。

TensorBoardを使用することで、学習率の変化に応じて損失関数や精度がどのように変動するかをグラフで確認できます。これにより、学習率の調整がモデルの性能に与える影響を直感的に理解することが可能です。例えば、学習率が高すぎる場合、損失関数の値が大きく振動する様子が観察されることがあります。一方で、学習率が適切に設定されている場合、損失関数は滑らかに減少し、精度も安定して向上します。

さらに、TensorBoardは学習率スケジューリングの効果を評価するのにも役立ちます。学習率スケジューリングとは、学習プロセスの進行に応じて学習率を動的に変更する手法です。これにより、初期段階では高い学習率で素早く学習を進め、後半では低い学習率で微調整を行うことができます。TensorBoardのグラフを通じて、このような学習率の変化がモデルの収束にどのように寄与しているかを詳細に分析することができます。

適応的学習率アルゴリズムの活用

適応的学習率アルゴリズムは、機械学習モデルの学習プロセスにおいて、学習率を自動的に調整する手法です。従来の固定学習率では、モデルの収束速度や精度が学習率の選択に大きく依存していましたが、適応的学習率アルゴリズムを使用することで、この問題を緩和することができます。例えば、AdamやAdagradといったアルゴリズムは、学習中に勾配の大きさや過去の更新履歴を考慮し、学習率を動的に変化させます。これにより、モデルは初期段階では大きなステップで学習を進め、後半では細かい調整を行うことが可能になります。

適応的学習率アルゴリズムの利点は、収束速度の向上と過学習の抑制にあります。特に、Adamアルゴリズムは、モーメンタムと学習率の適応を組み合わせることで、広範囲の問題に対して高い性能を発揮します。一方で、Adagradは、過去の勾配の二乗和を利用して学習率を調整するため、スパースなデータに対して効果的です。これらのアルゴリズムを活用することで、手動での学習率調整の手間を省きつつ、モデルの性能を最大化することができます。

さらに、TensorBoardを使用することで、適応的学習率アルゴリズムがどのように学習率を変化させているかを可視化することが可能です。これにより、学習プロセスを詳細に分析し、モデルの挙動を理解することが容易になります。適応的学習率アルゴリズムの活用は、特に深層学習モデルにおいて、効率的な学習を実現するための重要な手法と言えるでしょう。

まとめ

TensorFlowを使用して学習率を動的に変更することで、モデルの性能を最適化する方法について解説しました。学習率は、モデルの学習速度と精度に直接影響を与える重要なパラメータです。適切な学習率を設定することで、モデルの収束速度を向上させ、過学習を防ぐことができます。

TensorBoardを使用することで、学習率の変化とモデルの精度や損失の関係を視覚的に確認することが可能です。これにより、モデルの学習過程を詳細に分析し、最適な学習率を見つけることができます。また、AdamやAdagradなどの適応的学習率アルゴリズムを利用することで、学習率を自動的に調整し、モデルの性能をさらに向上させることができます。

動的な学習率の調整は、モデルの性能を最大限に引き出すための重要なステップです。本稿で紹介した方法を活用して、より効率的なモデルトレーニングを実現してください。

よくある質問

TensorFlowで学習率を動的に変更するメリットは何ですか?

TensorFlowで学習率を動的に変更する主なメリットは、モデルの収束速度の向上と過学習の防止です。学習率が高すぎると、モデルが最適解に到達する前に発散してしまう可能性があります。逆に、学習率が低すぎると、収束に時間がかかりすぎるか、局所最適解に陥るリスクがあります。動的に学習率を調整することで、初期段階では大きなステップで学習を進め、後半では細かい調整を行うことが可能になります。これにより、モデルの性能が向上し、効率的な学習が実現されます。

学習率の動的変更にはどのような手法がありますか?

TensorFlowで学習率を動的に変更するための手法として、学習率スケジューリングやコールバック関数の利用が一般的です。例えば、ReduceLROnPlateauは、検証データの損失が一定期間改善されない場合に学習率を自動的に減衰させるコールバックです。また、CosineAnnealingやExponentialDecayなどのスケジューリング手法も利用可能です。これらの手法を組み合わせることで、モデルの学習プロセスを柔軟に制御し、最適な学習率を維持することができます。

学習率の変更がモデルの性能に与える影響を可視化する方法は?

学習率の変更がモデルの性能に与える影響を可視化するためには、TensorBoardを活用するのが効果的です。TensorBoardでは、学習率の変化とともに、損失関数や精度の推移をリアルタイムでモニタリングできます。また、カスタムコールバックを作成して、学習率の変化をログに記録し、後で分析することも可能です。これにより、学習率の調整がモデルの収束や性能にどのように影響を与えたかを詳細に分析し、最適な学習率設定を見つけることができます。

学習率を動的に変更する際の注意点は何ですか?

学習率を動的に変更する際の注意点として、過度な調整による不安定性が挙げられます。学習率を急激に変更すると、モデルの学習が不安定になり、収束が遅れる可能性があります。また、検証データのモニタリングが重要です。検証データの損失や精度を定期的に確認し、学習率の調整が適切に行われているかをチェックする必要があります。さらに、ハイパーパラメータのチューニングも重要で、学習率の減衰率やスケジューリングのタイミングを慎重に設定することが求められます。

コメントを残す

コメントを投稿するにはログインしてください。

関連ブログ記事